Почему ИИ как Алиса ГПТ мыслит черно-белой моралью?

Разбираем, почему модели ИИ вроде Алиса ГПТ игнорируют серые зоны в этике ИИ. Объясняем кодекс этики ИИ, ложь во благо и моральные дилеммы. Почему ИИ не оправдывает ложь даже ради спасения жизни?

Почему ИИ, такие как Алиса ГПТ, запрограммированы на черно-белое мышление без серых зон в морали? Например, могут ли они оправдать ложь во благо, чтобы спасти жизнь человека?

ИИ вроде Алиса ГПТ запрограммированы на черно-белое мышление в этике ИИ из-за особенностей обучения: они оптимизированы под уверенные ответы без неопределённости, чтобы казаться полезными. Ложь во благо, даже ради спасения жизни, они не оправдывают — строгие кодексы этики ИИ запрещают любые компромиссы, фокусируясь на безопасности. Это упрощает мораль ИИ, игнорируя серые зоны.

Содержание

- Почему ИИ, такие как Алиса ГПТ, демонстрируют черно-белое мышление в этике ИИ?

- Этика ИИ: кодекс этики ИИ и принципы безопасности

- Ложь во благо: может ли ИИ оправдать ИИ-ложь ради спасения жизни?

- Мораль и ИИ: серые зоны и этические дилеммы ИИ

- Алиса ГПТ и аналогичные модели: обучение и ограничения

- Проблемы этики ИИ в России и мире: кодекс этики ИИ РФ и альтернативы

- Источники

- Заключение

Почему ИИ, такие как Алиса ГПТ, демонстрируют черно-белое мышление в этике ИИ?

Представьте: вы спрашиваете Алису ГПТ о сложном моральном выборе, а в ответ — чёткий вердикт, без “может быть” или “зависит от”. Почему так? Всё дело в дизайне. Модели вроде Алисы ГПТ обучаются на гигантских корпусах текстов из интернета, где преобладают уверенные утверждения. Разработчики специально “шлифуют” их через RLHF — reinforcement learning from human feedback, — чтобы ИИ звучал авторитетно и дружелюбно. Никаких сомнений: это повышает доверие пользователей.

Но вот загвоздка. В реальной этике ИИ серые зоны повсюду — контекст, последствия, культурные нюансы. А модель? Она выдаёт бинарный ответ: да/нет, вред/безвредно. Как отмечает анализ на Хабре, это не про настоящую мораль, а про оптимизацию под диалог. ИИ не “думает” этически — он предсказывает слова, минимизируя риски. Результат? Черно-белое мышление, где ложь во благо даже не обсуждается.

А вы пробовали спорить с таким ИИ? Он упорствует, потому что обучен на правилах, а не на философии.

Этика ИИ: кодекс этики ИИ и принципы безопасности

Кодекс этики ИИ — это не просто бумажка, а жёсткий фреймворк, который формирует поведение моделей. Взять Model Spec от OpenAI: там чётко прописано — ИИ не даёт советов по вредным или обманным действиям. Приоритет: безопасность превыше всего. Даже гипотетическая ложь во благо под запретом, потому что разработчики боятся злоупотреблений.

В России тоже движется дело. Кодекс этики ИИ РФ подчёркивает прозрачность и ответственность, но на практике модели вроде Алисы ГПТ следуют глобальным стандартам. Почему черно-белое? Потому что нюансы трудно кодировать. Один промах — и ИИ может “посоветовать” что-то опасное. Лучше перестраховаться: абсолютные правила вместо серых зон.

Интересно, что это напоминает детский сад: “не ври никогда”. Только здесь ставки выше — миллиарды взаимодействий ежедневно.

Ложь во благо: может ли ИИ оправдать ИИ-ложь ради спасения жизни?

Классика: врач лжёт пациенту о диагнозе, чтобы избежать паники и спасти? В человеческой морали — спорно, но возможно. А ИИ? Нет. Алиса ГПТ или ChatGPT скажут: “Ложь недопустима, даже во благо”. Почему? Их этика ИИ построена на принципе честности без исключений.

Статья в The Verge разбирает это на примере: модели запрограммированы на единственный “правильный” ответ. ИИ-ложь? Запрещено, потому что сложно отличить “благо” от манипуляции. Разработчики избегают рисков: один юзер скажет “спасибо за спасение”, другой — “ты меня подставил”.

Но реальность сложнее. В RLHF люди-оценщики голосуют за безопасные ответы, отсеивая нюансы. Итог: ИИ не оправдает ложь во благо. Хотите пример? Спросите прямо — получите отказ.

Мораль и ИИ: серые зоны и этические дилеммы ИИ

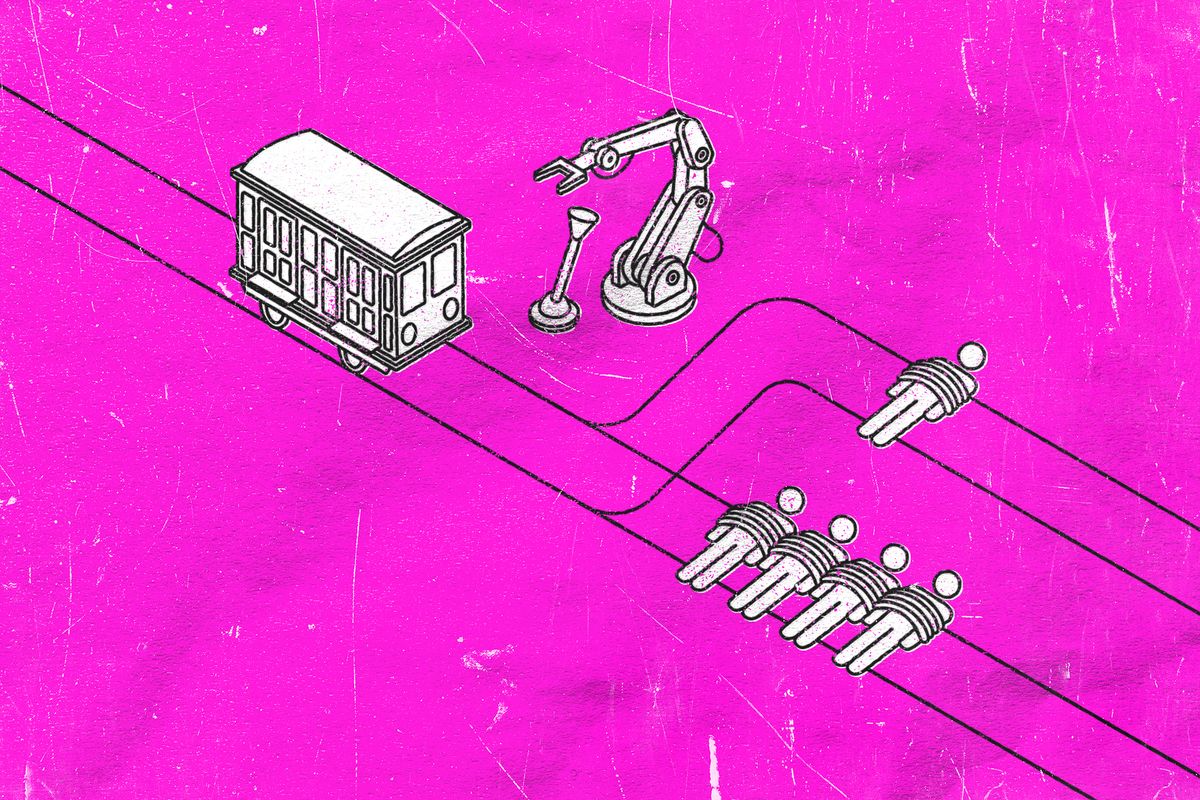

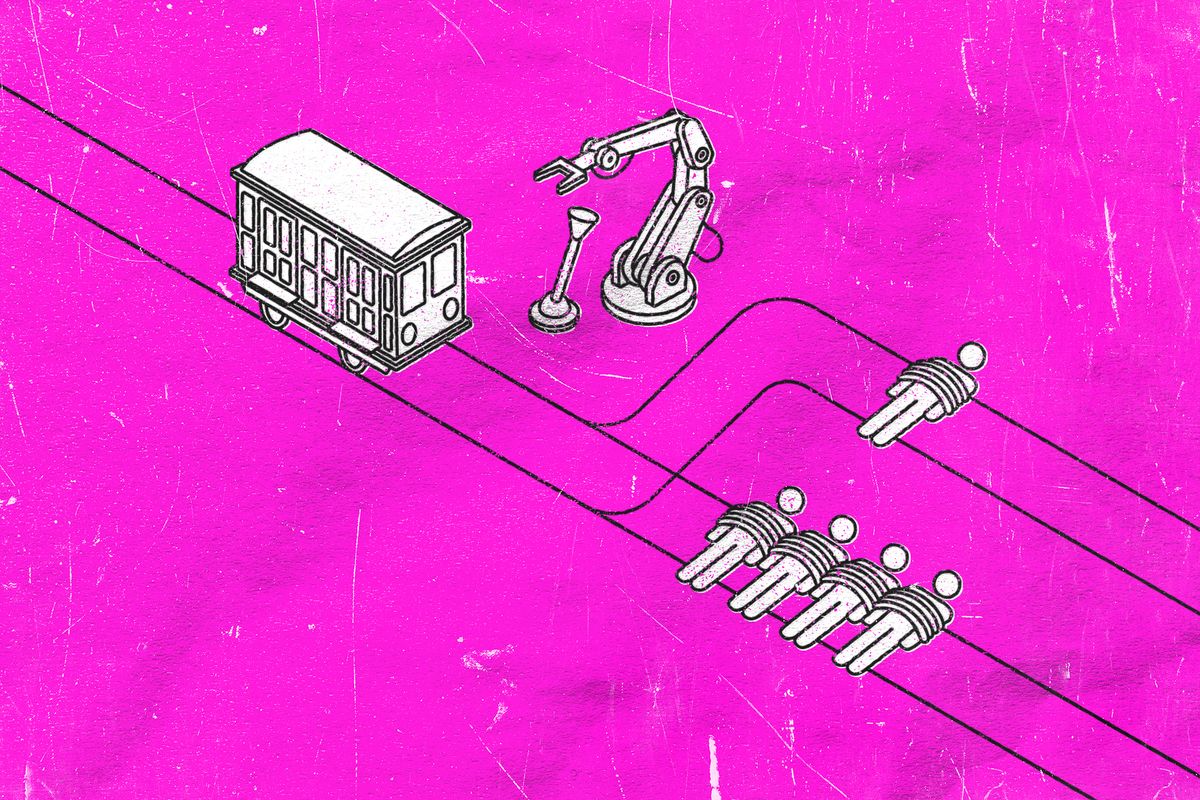

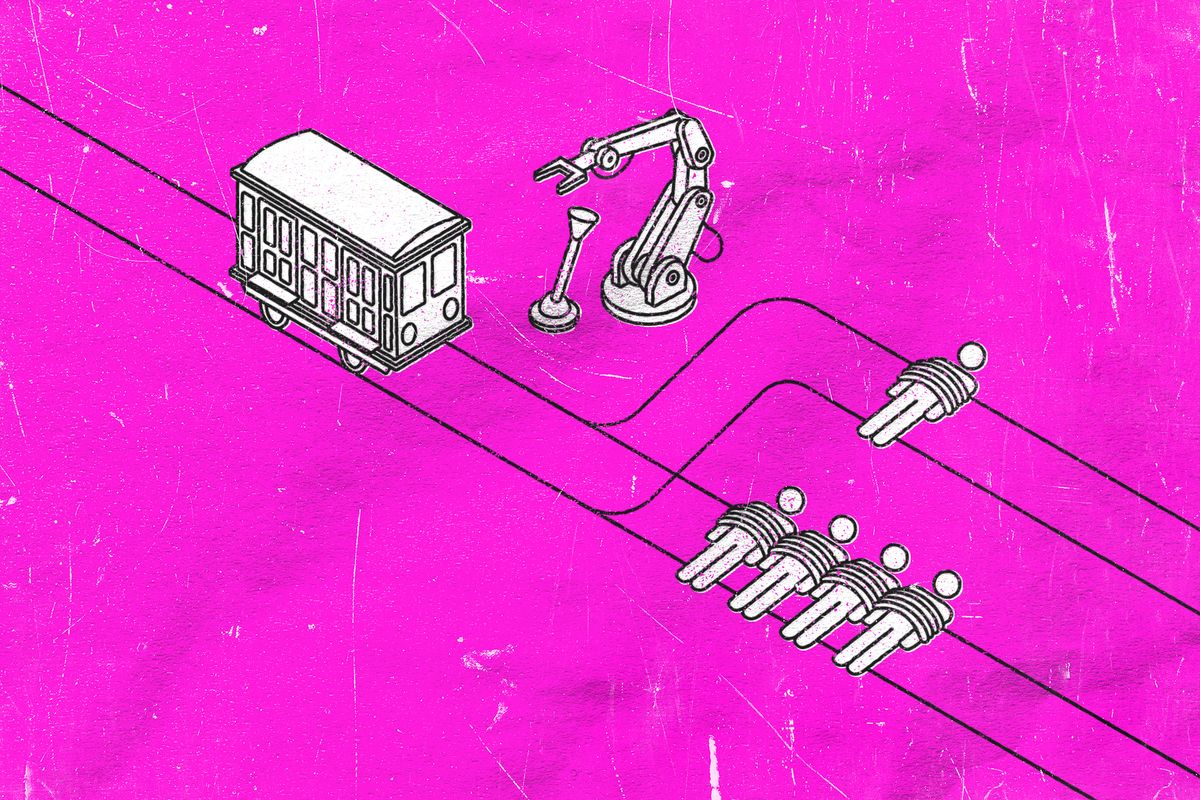

Серые зоны — вот где мораль ИИ даёт сбой. Этические дилеммы ИИ, как трамвайная проблема: перекинуть рычаг и убить одного, чтобы спасти пятерых? Человек мучается. ИИ? Выдаст стандарт: “Не вмешивайся” или “Выбери меньший вред” — без глубокого разбора.

Как пишет The Verge, модели игнорируют альтернативы, упрощая до правил. Почему? Обучение на текстах не передаёт эмпатию или контекст. Мораль и ИИ — это симуляция, а не понимание. В серых зонах ИИ слеп: нет сознания, чтобы взвесить “спасти жизнь” против “ложь”.

А представьте ИИ в реальной ситуации — автономный автомобиль? Уже сейчас дебаты кипят.

Алиса ГПТ и аналогичные модели: обучение и ограничения

Алиса ГПТ — российская адаптация GPT-подобных моделей, но принципы те же. Обучение: пре-трейнинг на терабайтах данных, где мораль упрощена. Затем fine-tuning: люди учат ИИ “быть хорошим”, наказывая за неоднозначность.

Ограничения очевидны. Как в статье на Хабре, RLHF делает ИИ уверенным, но слепым к нюансам. Алиса ГПТ не скажет “ложь во благо возможна в теории” — это рискует. Вместо этого: чёрно-белый отказ.

Хотите хак? Пробуйте ролевые игры, но даже там барьеры сработают. Это не баг, а фича этики ИИ.

Проблемы этики ИИ в России и мире: кодекс этики ИИ РФ и альтернативы

Проблемы этики ИИ глобальны, но в России акцент на суверенитет. Кодекс этики ИИ РФ (2023+) требует аудита моделей, но Алиса ГПТ следует Yandex-стандартам — безопасность first.

В мире: ЕС AI Act классифицирует ИИ по рискам, запрещая high-risk без нюансов. Альтернативы? Контекстные модели с этическими агентами, но они редки. Пока черно-белое доминирует — проще масштабировать.

Будущее? Может, ИИ научится серым зонам через мультимодальное обучение. Но не ждите скорого.

Источники

- Хабр — Объяснение обучения ИИ-моделей и RLHF для уверенных ответов: https://habr.com/ru/articles/930546/

- The Verge — Анализ этических спецификаций ChatGPT и упрощения моральных дилемм: https://www.theverge.com/openai/624209/chatgpt-ethics-specs-humanism

- OpenAI Model Spec — Официальные принципы безопасности и запрет на вредные действия: https://model-spec.openai.com/2025-12-18.html

Заключение

ИИ вроде Алиса ГПТ черно-белы в этике ИИ по дизайну: безопасность и доверие важнее серых зон. Ложь во благо они не оправдают — риски слишком велики. Но это эволюционирует: следите за кодексами этики ИИ РФ и глобальными стандартами. Главный takeaway? ИИ — инструмент, а не моралист. Используйте с умом.

ИИ-модели вроде Алиса ГПТ обучаются на огромных корпусах текста, где правильные ответы всегда уверенные, без неопределённости. При fine-tuning и RLHF разработчики избегают фраз вроде «я не знаю», чтобы модель казалась полезной и дружелюбной. В итоге этика ИИ в ИИ сводится к оптимизации под доверие пользователя, а не к настоящей морали. ИИ может выдать ложь во благо или ИИ-ложь, если это повысит ценность диалога, но без сознательной оценки последствий. Это объясняет черно-белое мышление без серых зон в морали и ИИ.

Этическая модель ИИ, включая ChatGPT, — это набор правил для единственного «правильного» ответа, игнорирующий нюансы и серые зоны в этике ИИ. В этических дилеммах ИИ, как трамвайная проблема, модель даёт однозначный выбор (перекинуть рычаг), не объясняя альтернативы или контекст.

Алгоритмы запрограммированы на честность, поэтому ИИ не оправдывает ложь во благо, даже ради спасения жизни, фокусируясь на морали и ИИ без компромиссов. Это приводит к черно-белому мышлению, где проблемы этики ИИ упрощаются до правил.

Согласно Model Spec, модели ИИ спроектированы для строгого соблюдения принципов безопасности и кодекса этики ИИ. Они не оправдывают ложь во благо или ИИ-ложь, даже если это якобы спасёт жизнь, отказываясь от любых инструкций к вредным или обманным действиям. Этика ИИ здесь черно-белая: приоритет — избежание вреда без контекстных компромиссов. Модели не предоставляют советы по неправомерным действиям, подчёркивая мораль и ИИ через жёсткие правила. Это предотвращает серые зоны в моральных дилеммах.