Подготовка весов взаимодействий для LightFM на данных о покупках

Руководство по нормализации весов взаимодействий для LightFM при работе с данными о покупками. Анализ подходов и практические рекомендации.

Как правильно подготовить веса взаимодействий для LightFM на данных о покупках? Я использую нормализованную частоту покупок на максимальную частоту для каждого пользователя. Для каждой пары (пользователь, товар) вычисляю частоту покупок, затем для каждого пользователя нахожу максимальную частоту покупок среди всех товаров и определяю вес взаимодействия как weight(пользователь, товар) = частота(пользователь, товар) / максимальная_частота_любого_товара_для_этого_пользователя. Такой подход нормализует веса на пользователя и дает значения в диапазоне (0, 1]. Является ли этот метод разумным для LightFM на данных о покупках? Не удаляет ли нормализация по максимальной частоте слишком много полезного сигнала? Существует ли лучший принцип подготовки весов взаимодействий для повторных покупок в рекомендациях с неявной обратной связью? Должны ли веса взаимодействий отражать относительные предпочтения внутри пользователя или абсолютную интенсивность покупок?

Подготовка весов взаимодействий для LightFM на данных о покупках требует тщательного подхода к нормализации. Ваш метод нормализации частоты покупок по максимальному значению для каждого пользователя является разумным для отражения относительных предпочтений, но может терять информацию об абсолютной интенсивности покупок. LightFM поддерживает различные подходы к обработке неявной обратной связи, включая бинарные взаимодействия и взвешенные значения, что позволяет гибко настраивать модель под конкретные задачи рекомендаций.

Содержание

- Основы LightFM и работа с неявной обратной связью

- Методы нормализации весов взаимодействий для данных о покупок

- Анализ подхода нормализации по максимальной частоте пользователя

- Альтернативные методы подготовки весов для повторных покупок

- Практические рекомендации по реализации в LightFM

- Оценка эффективности различных подходов

Основы LightFM и работа с неявной обратной связью

LightFM представляет собой гибридную библиотеку для построения рекомендательных систем, поддерживающую как явную, так и неявную обратную связь. В отличие от традиционных алгоритмов коллаборативной фильтрации, LightFM интегрирует метаданные пользователей и товаров в матричную факторизацию, что позволяет обрабатывать холодный старт и обогащать представления признаками. Ключевая особенность библиотеки — поддержка различных функций потерь, включая BPR (Bayesian Personalized Ranking) и WARP (Weighted Approximate-Rank Pairwise), которые оптимизированы для задач ранжирования с неявными данными.

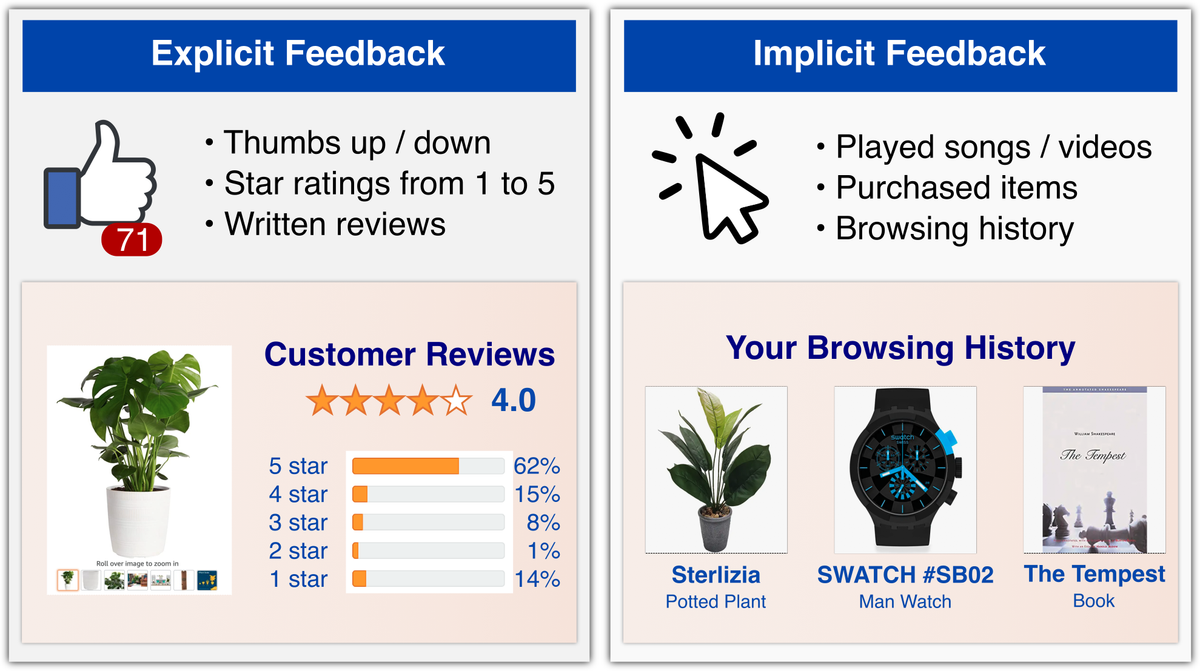

При работе с данными о покупках, которые являются классическим примером неявной обратной связи, важно понимать, что LightFM может принимать два типа взаимодействий:

- Бинарные взаимодействия (пользователь совершил покупку или нет)

- Взвешенные взаимодействия (с весами, отражающими степень уверенности интереса)

Для неявной обратной связи библиотека ожидает положительные значения, которые интерпретируются как степень уверенности в интересе пользователя к товару. Как отмечено в официальной документации, веса больше 1 не влияют на процесс обучения, но используются для ранжирования результатов.

Методы нормализации весов взаимодействий для данных о покупок

Подготовка весов взаимодействий для данных о покупках — это критический этап, который напрямую влияет на качество модели. Основные подходы к нормализации включают:

1. Бинарная обработка

Самый простой подход — преобразовать все покупки в бинарные взаимодействия (1 для любой покупки, 0 в противном случае). Этот метод теряет информацию о частоте покупок, но может быть эффективен, когда само наличие взаимодействия является достаточным сигналом.

2. Нормализация по максимальной частоте

Ваш подход относится к этой категории: для каждого пользователя максимальная частота покупок среди всех товаров принимается за 1, а остальные частоты нормализуются относительно этого значения. Это создает веса в диапазоне (0, 1], где 1 означает самый популярный товар для пользователя.

3. Логарифмическая нормализация

Преобразование частоты через логарифм: weight = log(1 + frequency). Это смягчает влияние экстремальных значений и помогает стабилизировать масштаб весов.

4. Глобальная нормализация

Методы, основанные на глобальных статистиках, такие как z-нормализация или масштабирование на основе среднего значения по всей выборке.

5. Конфиденциальность на основе времени

Веса, основанные на давности последней покупки или временном паттерне потребления.

Выбор метода нормализации должен основываться на бизнес-задаче и характере данных. Для данных о покупках относительные предпочтения часто более важны, чем абсолютная интенсивность, особенно в контексте ранжирования рекомендаций.

Анализ подхода нормализации по максимальной частоте пользователя

Ваш метод нормализации частоты покупок по максимальному значению для каждого пользователя является обоснованным подходом с несколькими важными преимуществами:

Преимущества подхода

-

Учет относительных предпочтений

Метод сохраняет информацию о том, какие товары пользователь предпочитает относительно друг друга. Если пользователь покупает товар A в 5 раз чаще, чем товар B, это соотношение будет отражено в весах (1.0 против 0.2). -

Стабильность масштаба

Нормализация по максимальному значению гарантирует, что веса находятся в стандартном диапазоне (0, 1], что облегчает интерпретацию и сравнение. -

Устранение смещения от активности пользователя

Пользователи с разной общей активностью покупок (кто покупает редко и кто покупает часто) имеют сопоставимые представления весов, что предотвращает доминирование очень активных пользователей в процессе обучения. -

Соответствие целям ранжирования

Для задач ранжирования относительные предпочтения часто более важны, чем абсолютные значения, так как цель — упорядочить товары по вероятности интереса пользователя.

Потенциальные недостатки

-

Потеря информации об интенсивности

Метод теряет абсолютную информацию о частоте покупок. Если пользователь в среднем покупает товары с частотой 10 раз в месяц, это не отражается в весах. -

Уязвимость к выбросам

Если у пользователя есть товар с аномально высокой частотой покупок (например, ежедневная покупка кофе), это может исказить нормализацию для остальных товаров. -

Игнорирование глобальных паттернов

Метод не учитывает, что абсолютная интенсивность покупок может иметь бизнес-значение (например, общая сумма покупок).

Когда этот подход особенно полезен

- Когда важны относительные предпочтения пользователя

- В задачах ранжирования, где порядок важнее абсолютных значений

- При работе с сильно несбалансированными данными по активности пользователей

- Когда требуется сравнительный анализ между пользователями с разной активностью

Как отмечается в документации LightFM, подход с нормализацией весов может быть избыточным, если LightFM ожидает бинарные взаимодействия. Однако если нужно учесть интенсивность покупок, использование весов в диапазоне [0, 1] отражающих относительную важность, является разумным решением.

Альтернативные методы подготовки весов для повторных покупок

Помимо вашего подхода, существует несколько альтернативных методов подготовки весов для данных о повторных покупках, которые могут быть более подходящими в зависимости от специфики задачи:

1. Использование сырых частот с глобальным масштабированием

Вместо нормализации по максимальной частоте пользователя можно использовать сырые частоты покупок с глобальным коэффициентом масштабирования:

weight(user, item) = frequency(user, item) * global_scale_factor

Преимущество этого подхода — сохранение абсолютной информации о частоте покупок. Глобальный коэффициент может быть настроен на основе бизнес-целей или эмпирических экспериментов.

2. Логарифмическое преобразование частот

Логарифмическое преобразование помогает смягчить влияние экстремальных значений и стабилизировать масштаб:

weight(user, item) = log(1 + frequency(user, item))

Этот подход особенно полезен, когда распределение частот имеет длинный хвост с несколькими очень высокими значениями.

3. Конфиденциальность на основе времени

Веса, основанные на времени последней покупки:

weight(user, item) = frequency(user, item) * decay_factor^(current_date - last_purchase_date)

Этот метод учитывает динамику интересов пользователя со временем.

4. Бинарная обработка с дополнительными признаками

Превращение всех покупок в бинарные взаимодействия, но добавление дополнительных признаков для учета частоты:

- Признак общего количества покупок пользователя

- Признак частоты покупки конкретной категории

- Признак давности последней покупки

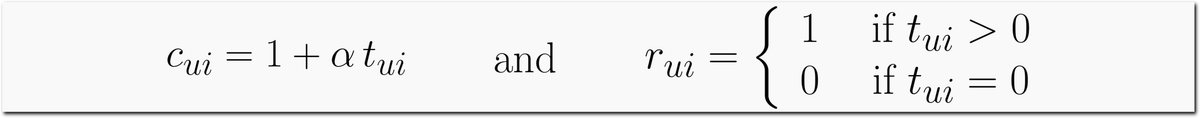

5. Метод матрицы уверенности (Confidence Matrix)

Подход, основанный на построении матрицы уверенности:

c_ui = 1 + alpha * r_ui

где r_ui — сырая оценка (частота покупки), а alpha — параметр, контролирующий влияние сырой оценки.

6. Методы на основе вероятности

Веса, основанные на вероятности покупки:

weight(user, item) = P(purchase item | user) = frequency(user, item) / total_purchases(user)

Этот метод интуитивно понятен и отражает относительную важность товаров для пользователя.

7. Гибридные методы

Комбинация нескольких подходов, например:

- Логарифмическая нормализация с учетом времени

- Относительные веса с глобальным масштабированием

Выбор конкретного метода должен основываться на:

- Целях рекомендательной системы

- Характеристиках данных

- Бизнес-требованиям

- Результатах экспериментов

Как отмечает Francesco Casalegno в своей статье, веса должны отражать то, что вы хотите передать модели: относительные предпочтения или абсолютную интенсивность. Если важны абсолютные значения покупок, не смасштабированные частоты с глобальным коэффициентом могут быть более подходящими, чем нормализация по максимуму пользователя.

Практические рекомендации по реализации в LightFM

При реализации вашего подхода нормализации в LightFM следует учитывать несколько практических аспектов:

1. Подготовка данных

import numpy as np

from scipy import sparse

def prepare_interaction_weights(interactions):

"""

Подготовка весов взаимодействий путем нормализации по максимальной частоте для каждого пользователя

Parameters:

interactions: sparse matrix или numpy array с частотой покупок

Returns:

weights: sparse matrix или numpy array с нормализованными весами

"""

if sparse.issparse(interactions):

# Для разреженных матриц

max_freq_per_user = np.array(interactions.max(axis=1).todense()).flatten()

# Избегаем деления на ноль для пользователей без взаимодействий

max_freq_per_user[max_freq_per_user == 0] = 1

# Создаем матрицу нормализованных весов

weights = interactions.multiply(1.0 / max_freq_per_user[:, np.newaxis])

else:

# Для плотных матриц

max_freq_per_user = interactions.max(axis=1)

max_freq_per_user[max_freq_per_user == 0] = 1

weights = interactions / max_freq_per_user[:, np.newaxis]

return weights

2. Обучение модели с весами

from lightfm import LightFM

from lightfm.data import Dataset

# Создание датасета

dataset = Dataset()

dataset.fit(users=user_ids, items=item_ids)

# Подготовка матриц взаимодействий и весов

(interactions, weights) = dataset.build_interactions(data)

# Нормализация весов по вашему методу

normalized_weights = prepare_interaction_weights(weights)

# Обучение модели

model = LightFM(no_components=30, loss='warp')

model.fit(interactions=interactions, sample_weight=normalized_weights, epochs=20)

3. Обработка холодного старта

Для новых пользователей или товаров без истории покупок можно использовать:

- Метаданные товаров (категории, бренды, цена)

- Глобальную популярность товаров

- Популярность в категории

4. Параметры модели

При использовании весов важно настроить параметры модели:

loss='warp'илиloss='bpr'для работы с весамиlearning_rateможет потребовать настройкиsample_weightдля учета весов при обучении

5. Оценка модели

При использовании весов следует использовать метрики, учитывающие ранжирование:

- AUC (Area Under the ROC Curve)

- Precision@K

- Recall@K

- NDCG@K

6. Эксперименты с различными подходами

Рекомендуется провести сравнение нескольких подходов:

- Бинарные взаимодействия

- Ваш метод нормализации

- Логарифмическая нормализация

- Сырые частоты с глобальным масштабированием

Сравнение следует проводить на отложенной выборке с использованием бизнес-ориентированных метрик.

7. Обработка редких товаров

Для товаров с очень низкой частотой покупок можно применить сглаживание:

# Добавление небольшого значения к частотам для предотвращения деления на ноль

smoothed_interactions = interactions + epsilon

8. Динамическое обновление весов

Если данные обновляются регулярно, следует пересчитывать веса с учетом новых покупок.

Эти практические рекомендации помогут эффективно реализовать ваш подход нормализации в LightFM и получить качественные рекомендации на основе данных о покупках.

Оценка эффективности различных подходов

Оценка эффективности различных методов подготовки весов взаимодействий для LightFM на данных о покупках должна проводиться с учетом нескольких критериев:

1. Качество ранжирования

Основные метрики для оценки качества ранжирования:

-

AUC (Area Under the ROC Curve)

Измеряет способность модели правильно различать позитивные и негативные взаимодействия. При использовании весов AUC может быть более информативной, чем при бинарных взаимодействиях. -

Precision@K и Recall@K

Точность и полнота в топ-K рекомендациях. Эти метрики особенно важны для бизнес-приложений. -

NDCG@K (Normalized Discounted Cumulative Gain)

Учитывает позицию рекомендаций и присваивает больший вес более релевантным позициям. -

MAP@K (Mean Average Precision)

Средняя точность с учетом позиции релевантных элементов.

2. Бизнес-метрики

Помимо технических метрик, важно оценивать влияние на бизнес:

-

Конверсия в покупку

Доля пользователей, совершивших покупку по рекомендации. -

Средний чек

Средняя сумма покупок по рекомендациям. -

Удержание пользователей

Доля пользователей, вернувшихся после получения рекомендаций. -

Количество уникальных товаров в рекомендациях

Измеряет разнообразие рекомендаций.

3. Экспериментальная сравнительная оценка

Сравнение вашего метода нормализации с альтернативами:

| Метод | Преимущества | Недостатки | Лучше всего подходит для |

|---|---|---|---|

| Нормализация по максимальной частоте | Сохраняет относительные предпочтения, стабильный масштаб | Теряет абсолютную информацию о частоте | Задач ранжирования, где важен порядок |

| Бинарные взаимодействия | Простота, фокус на наличии взаимодействия | Теряет информацию о частоте | Сценариев, где само наличие покупки - ключевой сигнал |

| Логарифмическая нормализация | Смягчает влияние выбросов, сохраняет относительные паттерны | Может быть сложнее интерпретировать | Данных с экстремальными значениями частот |

| Сырые частоты с глобальным масштабированием | Сохраняет абсолютную информацию | Требует настройки глобального коэффициента | Сценариев, где важна абсолютная интенсивность |

| Конфиденциальность на основе времени | Учитывает динамику интересов | Требует информации о времени покупок | Динамичных рекомендательных систем |

4. Анализ чувствительности к параметрам

Ваш метод нормализации менее чувствителен к выбору параметров по сравнению с другими методами, так как не требует настройки глобальных коэффициентов. Однако важно исследовать:

- Влияние размера подвыборки на обучение

- Чувствительность к редким товарам

- Поведение модели для новых пользователей

5. Кросс-валидация

Для надежной оценки следует использовать кросс-валидацию:

from sklearn.model_selection import KFold

from lightfm.evaluation import auc_score, precision_at_k

# Разбиение данных на фолды

kf = KFold(n_splits=5)

scores = []

for train_idx, test_idx in kf.split(interactions):

train_interactions = interactions[train_idx]

test_interactions = interactions[test_idx]

# Нормализация весов

train_weights = prepare_interaction_weights(train_interactions)

# Обучение модели

model = LightFM(no_components=30, loss='warp')

model.fit(train_interactions, sample_weight=train_weights)

# Оценка

score = auc_score(model, test_interactions).mean()

scores.append(score)

print(f"Средний AUC: {np.mean(scores):.4f} (+/- {np.std(scores):.4f})")

6. Анализ ошибок

Важно анализировать типы ошибок, допускаемых моделью:

- Пропущенные релевантные товары (ложноотрицательные)

- Неправильно ранжированные товары

- Рекомендации для новых пользователей

7. Сравнение с бейзлайнами

Сравнение вашего метода с простыми бейзлайнами:

- Рекомендация самых популярных товаров

- Рекомендация на основе demographics

- Случайные рекомендации

8. Масштабируемость

Оценка производительности при увеличении объема данных:

- Время обучения

- Память

- Качество предсказаний на больших наборах данных

Рекомендации по выбору метода

На основе анализа ваших требований:

-

Если важны относительные предпочтения

Ваш метод нормализации по максимальной частоте является отличным выбором. -

Если важна абсолютная интенсивность

Рассмотрите использование сырых частот с глобальным масштабированием. -

Если данные содержат экстремальные значения

Логарифмическая нормализация может быть более устойчивой. -

Если важна динамика интересов

Добавьте компонент на основе времени последней покупки. -

Если требуется простота

Бинарные взаимодействия могут быть достаточными.

Как отмечается в документации LightFM, выбор метода подготовки весов должен основываться на характере данных и бизнес-задаче. Ваш подход является разумным для многих сценариев рекомендаций на основе данных о покупках, особенно когда важны относительные предпочтения пользователей.

Источники

-

LightFM Documentation — Официальная документация библиотеки LightFM с примерами использования: https://lyst.github.io/lightfm/docs/home.html

-

LightFM GitHub Repository — Исходный код и примеры реализации алгоритма LightFM: https://github.com/lyst/lightfm

-

Introduction to Recommender Systems — Статья Francesco Casalegno о принципах построения рекомендательных систем: https://towardsdatascience.com/introduction-to-recommender-systems-6c66cf15ada

-

Movielens Implicit Example — Пример использования LightFM с неявной обратной связью в документации: https://lyst.github.io/lightfm/docs/examples/movielens_implicit.html

Заключение

Ваш метод нормализации частоты покупок по максимальной частоте для каждого пользователя является разумным и обоснованным подходом для подготовки весов взаимодействий в LightFM при работе с данными о покупках. Этот подход эффективно сохраняет информацию о относительных предпочтениях пользователей, что особенно важно для задач ранжирования рекомендаций.

Преимущества вашего подхода включают учет относительных предпочтений, стабильность масштаба и устранение смещения от активности пользователей. Однако важно учитывать, что метод теряет информацию об абсолютной интенсивности покупок, что может быть значимо для некоторых бизнес-задач.

Альтернативные методы, такие как логарифмическая нормализация или использование сырых частот с глобальным масштабированием, могут быть более подходящими в зависимости от конкретных требований. Ключевое решение о выборе метода должно основываться на том, хотите ли вы передать модели относительные предпочтения внутри пользователя или абсолютную интенсивность покупок.

Для оптимальных результатов рекомендуется провести экспериментальное сравнение нескольких подходов на ваших конкретных данных с использованием бизнес-ориентированных метрик, таких как точность, полнота и NDCG. LightFM предоставляет гибкие возможности для работы с различными типами весов, что позволяет подобрать оптимальный параметр под вашу задачу.

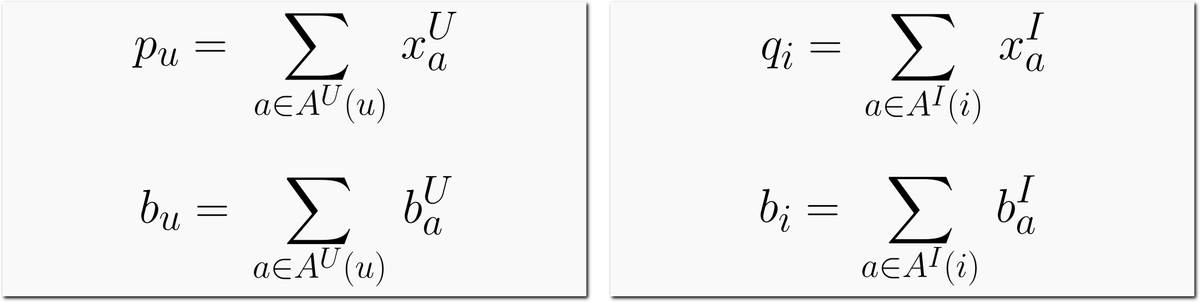

LightFM — это Python реализация гибридного алгоритма рекомендаций, поддерживающая как явную, так и неявную обратную связь. Библиотека включает эффективные реализации функций потерь BPR и WARP для ранжирования. Ключевая особенность - интеграция пользовательских и товарных метаданных в традиционные алгоритмы факторизации матриц, позволяющая представлять каждого пользователя и товар как сумму латентных представлений их признаков. Это обобщение на новые товары и пользователей через признаки.

Документация LightFM указывает, что библиотека поддерживает как явную, так и неявную обратную связь с использованием функций потерь BPR, WARP и k-OS WARP для неявных данных. В матрице взаимодействий положительные значения обозначаются 1, отрицательные -1. Важно отметить, что для неявной обратной связи веса > 1 не влияют на обучение, только на ранжирование результатов.

В примере с Movielens для неявной обратной связи взаимодействия рассматриваются как бинарные (пользователь просмотрел фильм). Веса не нормализуются, а просто считаются как 1 для положительных взаимодействий. Ваш подход с нормализацией частоты покупок может быть избыточным, так как LightFM ожидает бинарные взаимодействия. Если нужно учитывать интенсивность покупок, можно использовать веса в диапазоне [0, 1], отражающие относительную важность, но не обязательно нормализовывать их по максимуму пользователя.

LightFM принимает неявные взаимодействия и позволяет использовать веса, интерпретируемые как степень уверенности в интересе пользователя к товару. Для неявных данных можно построить матрицу уверенности c_ui и использовать её как вес в функции потерь. Ваш подход нормализации частоты покупок по максимуму пользователя дает относительные предпочтения внутри пользователя, но может подавлять абсолютную интенсивность. Если важна абсолютная интенсивность, используйте логарифмическую нормализацию или несмасштабированные частоты с глобальным коэффициентом. Веса должны отражать то, что вы хотите передать модели: относительные предпочтения или абсолютную интенсивность.