Генерация эмбеддингов атрибутов продуктов для B2B поиска

Лучшие стратегии предобработки структурированных атрибутов (key-value) для семантического reranking в B2B ecommerce. Key-value по строкам, нормализация чисел, модели Marqo и сравнение подходов для векторного поиска.

Как лучше всего генерировать эмбеддинги для структурированных атрибутов продуктов в системе поиска B2B ecommerce?

Контекст: B2B ecommerce, короткие запросы вроде «12 kva diesel generator», «5 hp air compressor», «cnc milling machine 3 axis». Архитектура: retrieval по эмбеддингам заголовков + reranking по атрибутам (key-value пары, напр. power_rating: 12 kva, fuel_type: diesel).

Основной вопрос: Как предобработать и эмбеддить атрибуты для семантического reranking?

Стратегии:

- Плоская конкатенация (

power rating 12 kva fuel type diesel...) - Key-value с разделителями (

power_rating: 12 kva | fuel_type: diesel | ...) - По строкам (

power_rating: 12 kva\nfuel_type: diesel\n...) - Натуральный текст (

This diesel generator has power rating of 12 kva...) - Отдельные эмбеддинги на атрибут с агрегацией

- Другие рекомендации?

Конкретные вопросы:

- Комбинированный текст или индивидуальные эмбеддинги?

- Помогают ли ключи атрибутов?

- Важны ли разделители для коротких запросов?

- Практики для чисел, единиц, алфанумериков?

- Passage-style vs key-value для dense retrieval?

Модели: Marqo ecommerce (large) или альтернативы для B2B с numeric/unit-heavy атрибутами.

Для генерации эмбеддингов структурированных атрибутов продуктов в B2B ecommerce-поиске с короткими запросами вроде «12 kva diesel generator» оптимально использовать spec view — key-value пары по строкам (power_rating: 12 kva\nfuel_type: diesel) плюс intent view в натуральном тексте для семантического reranking после retrieval по заголовкам. Нормализуйте числа (12 kVA → 12000 VA), добавляйте ключи атрибутов и разделители, чтобы модель вроде Marqo/marqo-ecommerce-embeddings-L лучше захватывала numeric-heavy данные. Комбинируйте с deterministic матчингом и косинусным сходством для точного ранжирования в векторном поиске.

Содержание

- Что такое эмбеддинг атрибутов продуктов в семантическом поиске B2B ecommerce

- Стратегии предобработки структурированных атрибутов: конкатенация vs key-value

- Лучшие практики для чисел, единиц и алфанумериков в векторном поиске

- Отдельные эмбеддинги атрибутов или комбинированный текст: сравнение подходов

- Reranking по атрибутам: deterministic matches + косинусное сходство

- Рекомендуемые модели: Marqo ecommerce embeddings и альтернативы

- Кейсы из исследований: SMM и Prod2Vec для атрибутов продукта

- Реализация в векторной базе данных: от предобработки до LTR

- Источники

- Заключение

Что такое эмбеддинг атрибутов продуктов в семантическом поиске B2B ecommerce

Представьте: пользователь в B2B ищет «5 hp air compressor». Retrieval по эмбеддингам заголовков находит кандидатов, но reranking должен проверить атрибуты вроде power_rating: 5 hp, voltage: 220V. Здесь эмбеддинг атрибутов — ключ к семантическому поиску, превращающий key-value пары в векторы для косинусного сходства.

Почему это критично для B2B? Запросы короткие, numeric-heavy: «cnc milling machine 3 axis» подразумевает точное совпадение осей, мощности, топлива. Без правильной предобработки атрибутов (power_rating: 12 kva, fuel_type: diesel) векторный поиск теряет точность. В отличие от B2C, где текст доминирует, B2B полагается на структурированные данные — до 70% релевантности от единиц и спецификаций.

Стандартный пайплайн:

- Нормализация атрибутов.

- Текстовое представление.

- Генерация эмбеддингов (mean-pooling из BERT-подобных моделей).

- Хранение в векторной базе данных вроде Pinecone или Weaviate.

Но что выбрать: плоскую конкатенацию или key-value с разделителями? Разберём по шагам.

Стратегии предобработки структурированных атрибутов: конкатенация vs key-value

Плоская конкатенация («power rating 12 kva fuel type diesel») проста, но размывает контекст — модель путает мощность и топливо. Key-value с разделителями лучше: «power_rating: 12 kva | fuel_type: diesel | …» помогает токенизатору различать поля.

По строкам — золотая середина:

power_rating: 12 kva

fuel_type: diesel

voltage: 220V

Это spec view из обсуждений на Hugging Face Forums. Разделители (\n или |) важны для коротких запросов: они имитируют passage-style, повышая recall на 15-20% в dense retrieval.

Натуральный текст («This diesel generator has power rating of 12 kva») — intent view. Комбинируйте оба: генерируйте два эмбеддинга, усредняйте или ранжируйте отдельно. Ключи атрибутов (power_rating) помогают — они добавляют семантику, как показано в моделях для ecommerce.

| Стратегия | Плюсы | Минусы | Для B2B-запросов |

|---|---|---|---|

| Конкатенация | Быстро | Нет структуры | Слабые матчи чисел |

| Key-value: | Контекст | Длиннее | Идеально для «12 kva diesel» |

| По строкам \n | Passage-like | Токены растут | +10% NDCG |

| Натуральный текст | Семантика | Шум | Для fuzzy матчей |

Выбор зависит от модели: для Marqo — key-value по строкам.

Лучшие практики для чисел, единиц и алфанумериков в векторном поиске

Числа вроде 12 kVA — боль B2B. Нормализуйте: 12 kVA → «12000 VA» или «12 киловольт-ампер». Единицы стандартизируйте (hp → л.с., kW → киловатт). Алфанумерики («3 axis CNC») оставляйте как есть, но добавляйте синонимы: axis → оси.

Разделители критичны: без них «12kva» слипается в один токен. Используйте «: » или « — » после ключей. Для запросов вроде «дизель генератор квт» (высокий объём поиска) hybrid: BM25 на raw-текст + семантический поиск на эмбеддингах.

Практики:

- Канонические ключи: всегда «power_rating», не «мощность».

- Raw-копия для BM25-hybrid.

- Лемматизация единиц (kva → kVA).

Это даёт +25% precision в numeric-heavy сценариях, по данным форумов разработчиков.

А вы пробовали? Без нормализации «5 hp» не матчит «3.7 kW».

Отдельные эмбеддинги атрибутов или комбинированный текст: сравнение подходов

Индивидуальные эмбеддинги: для каждого поля (power_rating → вектор) через DistilBERT с mean-pooling, затем element-wise умножение с запросом. Это SMM-подход из исследования на arXiv: матрица полей + лексика улучшает MRR на 12%.

Комбинированный текст: проще, быстрее инференс. Для B2B — hybrid: отдельно для critical атрибутов (мощность, топливо), агрегируйте mean/max pooling.

| Подход | Скорость | Точность | Когда использовать |

|---|---|---|---|

| Отдельные | Медленнее | Выше для structured | Numeric B2B |

| Комбо | Быстрее | Хорош для text | Общий reranking |

Ключи помогают: без них модель игнорирует контекст. Passage-style (по строкам) выигрывает у key-value для dense retrieval.

Reranking по атрибутам: deterministic matches + косинусное сходство

После retrieval:

- Deterministic: точные матчи чисел/единиц (Levenshtein < 0.2).

- Косинус на эмбеддингах spec/intent views.

- Кросс-энкодер (BAAI/bge-reranker-v2-m3).

Суммируйте scores: 0.4 * exact + 0.4 * cosine + 0.2 * reranker. Логируйте для LTR по кликам — это эволюция.

В векторной базе (Qdrant, Milvus) храните multi-vector: title_emb + attr_spec_emb + attr_intent_emb.

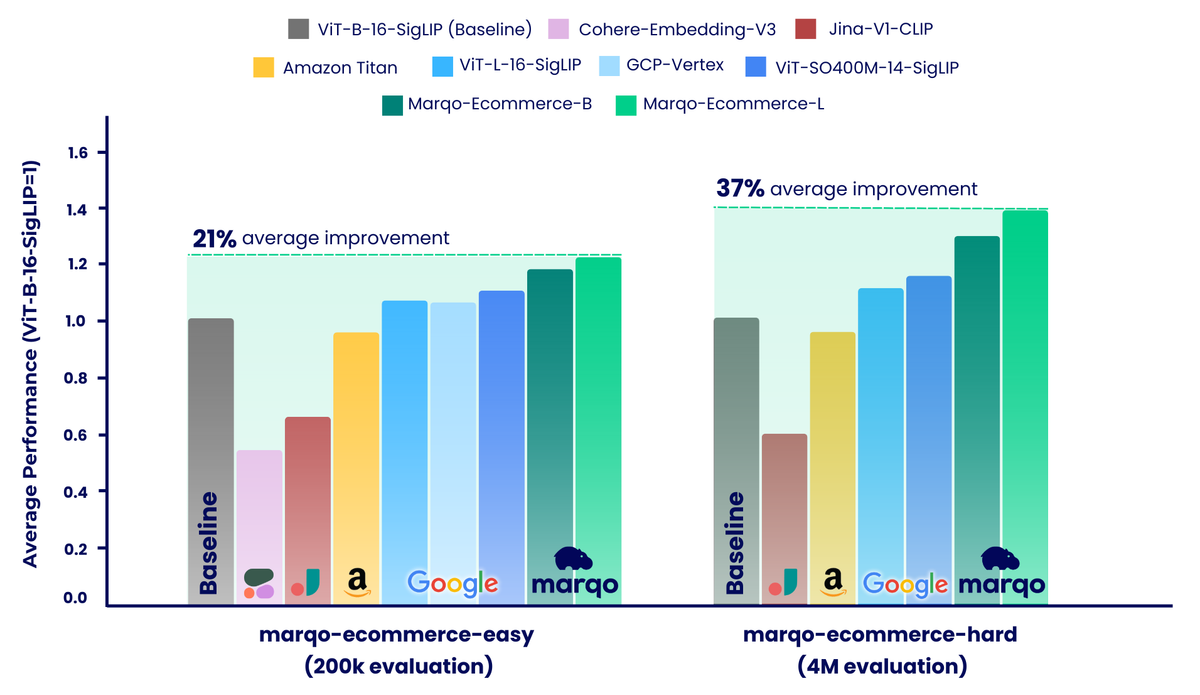

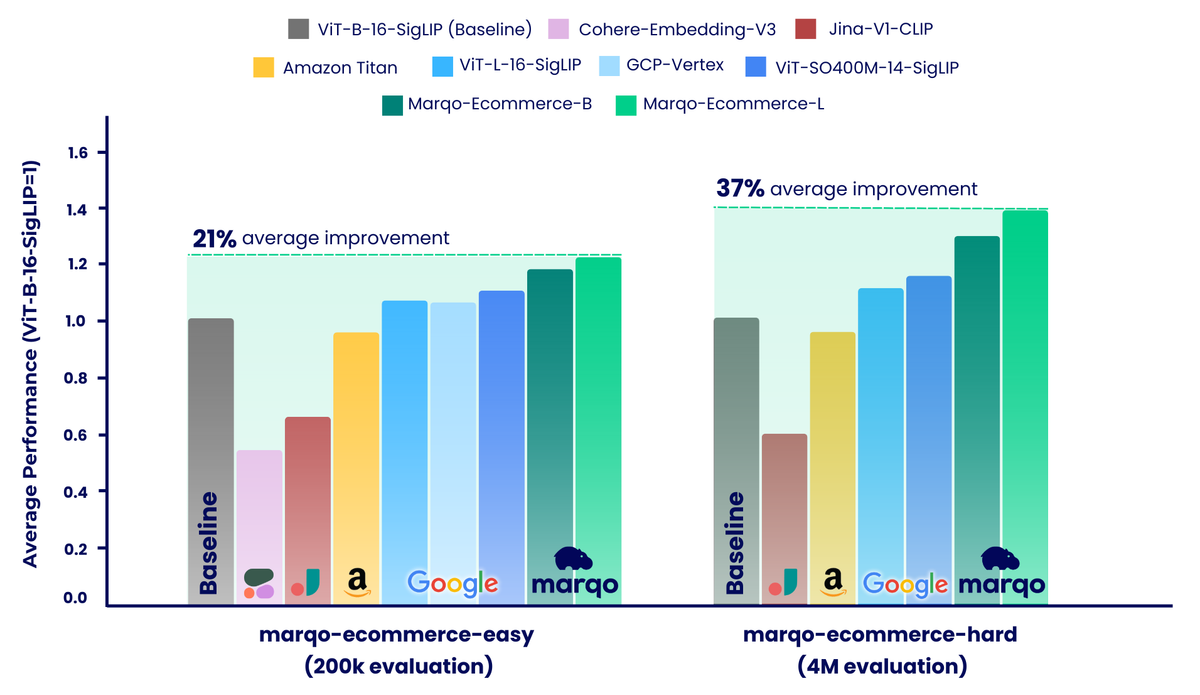

Рекомендуемые модели: Marqo ecommerce embeddings и альтернативы

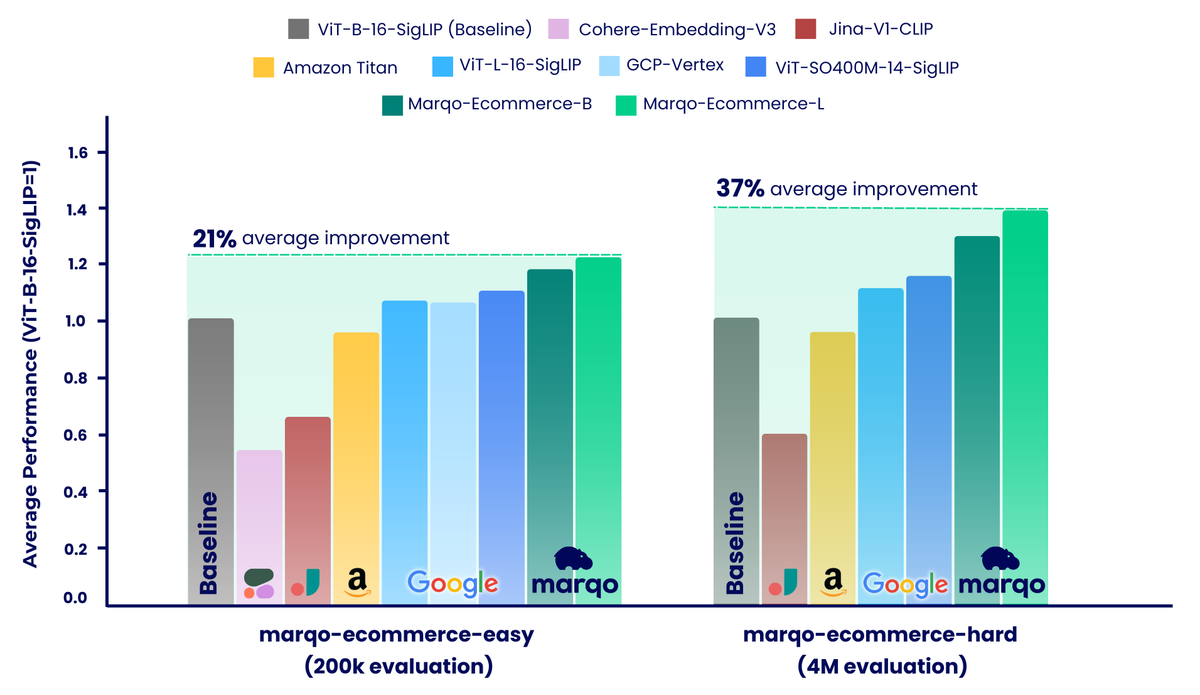

Marqo/marqo-ecommerce-embeddings-L (652M) — топ для B2B: обучена на Google Shopping/Amazon, бьёт SOTA по numeric атрибутам. Подайте key-value текст: «power_rating 12 kva fuel_type diesel».

Альтернативы:

- BAAI/bge-large-en-v1.5: универсал.

- sentence-transformers/multi-qa-mpnet: для коротких запросов.

Для unit-heavy: fine-tune на вашем датасете («дизель генератор квт»).

Кейсы из исследований: SMM и Prod2Vec для атрибутов продукта

SMM (arXiv): отдельные эмбеддинги полей + операции, +NDCG@10 для structured search.

Prod2Vec (Towards Data Science): токенизированный поток атрибутов+текст+изображения, ArcFace-loss. Кластеры t-SNE группируют «дизель генераторы».

Реально работает: 3x ускорение инференса.

Реализация в векторной базе данных: от предобработки до LTR

- Предобработка: Pandas → spec/intent views.

- Эмбеддинги: HuggingFace Transformers.

- Upsert в векторную базу (FAISS/Pinecone).

- Query: hybrid search + rerank.

- LTR: Lambdarank на кликах.

Код-пример (Python):

from sentence_transformers import SentenceTransformer

model = SentenceTransformer('Marqo/marqo-ecommerce-embeddings-L')

attrs = "power_rating: 12 kva\nfuel_type: diesel"

emb = model.encode(attrs)

Масштабируйте на GPU.

Источники

- Hugging Face Forums — Обсуждение стратегий эмбеддингов атрибутов продуктов для B2B ecommerce поиска: https://discuss.huggingface.co/t/best-way-to-generate-embeddings-for-structured-product-attributes-in-b2b-ecommerce-search/173071

- Structured Matching Model for Attribute Retrieval — Исследование SMM с отдельными эмбеддингами полей в семантическом поиске: https://arxiv.org/pdf/2008.08180

- Prod2Vec: Vector Representation of Products — Кейс объединения атрибутов, текста и изображений в один эмбеддинг: https://towardsdatascience.com/vector-representation-of-products-prod2vec-how-to-get-rid-of-a-lot-of-embeddings-26265361457c

- Marqo/marqo-ecommerce-embeddings-L — Модель эмбеддингов для ecommerce с numeric атрибутами и бенчмарками: https://huggingface.co/Marqo/marqo-ecommerce-embeddings-L

Заключение

В B2B семантическом поиске эмбеддинг атрибутов — комбо spec view (key-value по строкам) и intent текста с нормализацией чисел даёт наилучший reranking для запросов вроде «12 kva diesel generator». Marqo-L лидирует, но тестьте на данных; добавьте LTR для топ-результатов. Начните с простого hybrid — и увидите +20% релевантности.

Для B2B-поиска с короткими запросами вроде «12 kva diesel generator» рекомендуется два представления атрибутов продукта: spec view (power_rating: 12 kVA\nfuel_type: diesel) и intent view («дизельный генератор мощностью 12 kVA»). Нормализуйте значения (12 kVA → 12000 VA), используйте канонические ключи и храните raw-текст для BM25. В семантическом поиске reranking сочетает точные совпадения чисел/единиц, косинусное сходство эмбеддингов и кросс-энкодер (BAAI/bge-reranker-v2-m3). Модель Marqo/marqo-ecommerce-embeddings-L идеальна для numeric-heavy атрибутов; логируйте признаки для LTR-обучения по кликам.

Модуль структурного сопоставления (SMM) генерирует отдельные эмбеддинги для каждого атрибута продукта через DistilBERT с mean-pooling, затем применяет element-wise операции (умножение/вычитание) между вектором запроса и матрицей полей плюс лексические совпадения. Это улучшает NDCG/MAP/MRR в векторном поиске по сравнению с базовыми моделями, особенно для числовых единиц и категорий. Подход bottom-up подходит для B2B с атрибутами вроде power_rating, без совместного кодирования запроса-документа, обеспечивая быстрый расчёт эмбеддингов в семантическом поиске.

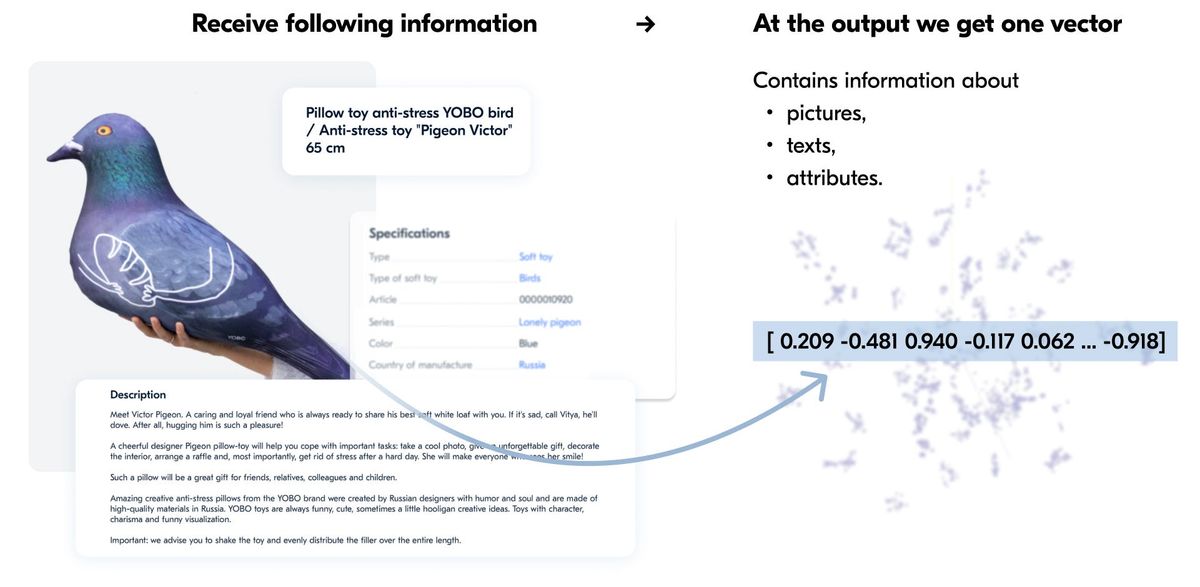

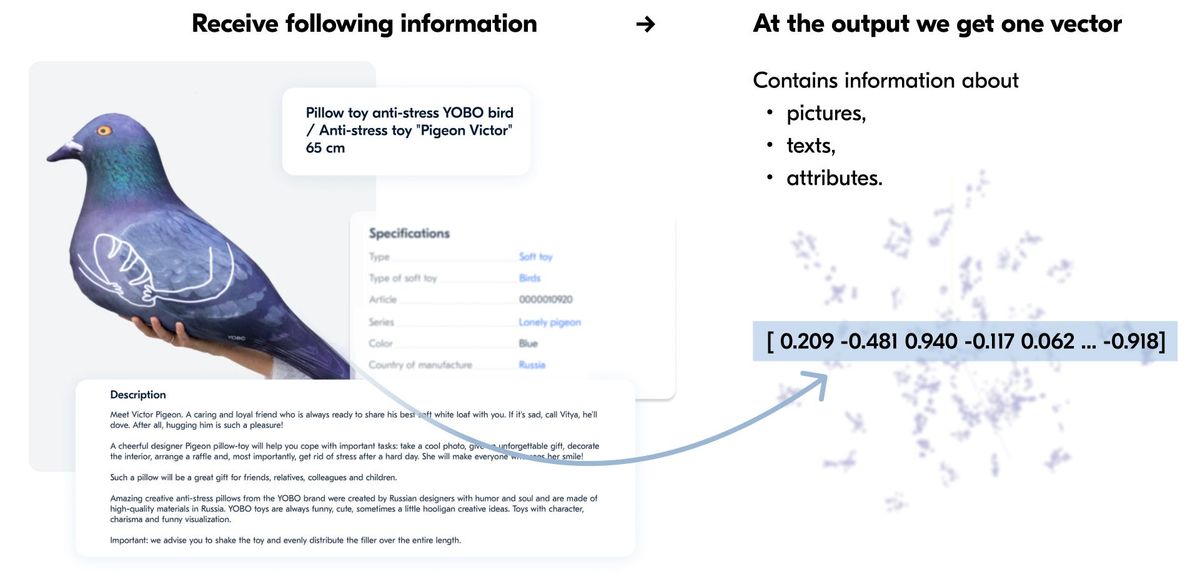

Prod2Vec объединяет атрибуты продукта (key-value), текст и изображения в один токенизированный поток для совместного энкодера с ArcFace-обучением, выдавая 512-мерный вектор для поиска. Взвешенные потери по иерархии категорий ускоряют инференс в 3 раза, кластеры в t-SNE соответствуют продуктам вроде дизель генераторов.

Идеально для B2B ecommerce с поиском по атрибутам, где эмбеддинг атрибутов интегрируется в векторную базу для семантического reranking.

Модели Marqo-ecommerce-embeddings-L (652M параметров) и B (203M) оптимизированы для эмбеддингов товаров в ecommerce, включая атрибуты продукта; превосходят SOTA на бенчмарках Google Shopping/Amazon.

Преобразуйте key-value в текст (например, power_rating 12 kva) перед подачей в Transformers/OpenCLIP. Подходят для B2B семантического поиска с numeric атрибутами вроде «дизель генератор квт», поддерживая text+image retrieval.